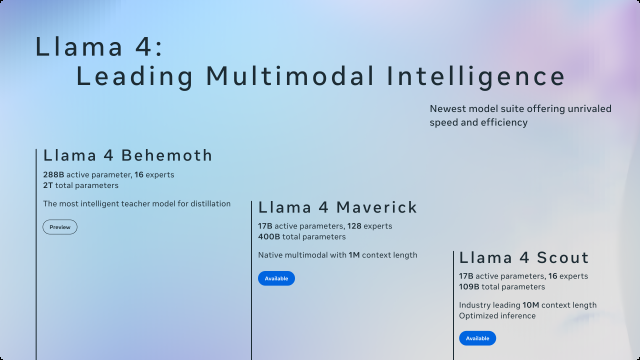

메타가 강력한 멀티모달 인공지능(AI) 대규모 언어 모델(LLM) ‘라마 4’를 공개하며, 글로벌 빅테크 기업 간 ‘에이전트 AI’ 경쟁에 불을 지폈다.

라마 4는 벤치마크 결과에서 일부 성능이 오픈AI의 GPT-4o, 구글의 제미나이 2.0 등 경쟁 모델을 앞서는 것으로 나타났다. 라마 4가 오픈소스로 제공되며 개발 비용이 낮아 빅테크와 스타트업 간 AI 소프트웨어 경쟁이 더욱 치열해질 것으로 전망된다.

7일 메타가 발표한 라마 4 벤치마크 결과에 따르면, 스카우트 모델은 문맥 이해 테스트에서 1000만 토큰 내 99.8% 정확도를 기록했다. 이는 GPT-4o(92%), 클로드 3.5 소넷(95%)보다 뛰어난 수치다.

스카우트는 다중 문서 요약에서 10개 문서(총 500만 토큰) 요약 시 로그(ROUGE) 점수 0.72를 획득해 xAI의 그록 2(0.65), 제미나이 2.0(0.68)을 앞섰다. 코드 분석에서는 50만 줄 분석에서 88% 정확도를 보이며 딥시크 v3.1(85%)을 근소한 차이로 상회했다. 다만 멀티모달(MMMU) 성능은 72점으로 GPT-4o(78점)에 미치지 못했다.

라마 4 매버릭은 챗봇 및 창작 작업에 특화됐으며, 멀티모달과 비용 효율성이 강점이다. 일반대화에서 8.9점을 기록해 제미나이 2.0(8.6점)을 앞섰으나 GPT-4o(9.1점)에는 뒤졌다. 코딩에서는 92% 해결률로 GPT-4o(90%), 딥시크 v3.1(91%)을 넘어섰다. 추론 성능은 85점으로 xAI 그록3(83점)를 상회했지만, GPT-4o(87점), 클로드 3.7 소넷(88점)에는 미치지 못했다. 멀티모달에서는 79점을 획득해 GPT-4o(82점)에 근접하며, 제미나이 2.0(76점)을 앞섰다.

현재 훈련 중인 비헤모스는 고성능 기초 LLM으로, 메타는 수학 문제 해결률 92%를 주장하며 GPT-4.5(90% 추정), 클로드 3.7 소넷(91%)을 앞선다고 밝혔다. 추론에서도 제미나이 2.0 프로(85점)를 넘어섰다고 전해진다.

라마 4의 가장 큰 장점은 추론 비용이 100만 토큰당 0.19~0.49달러로, GPT-4o(4.38달러)보다 약 10배 저렴하다는 점이다. 이는 AI 개발 비용을 크게 줄여준다는 의미다.

낮은 비용과 뛰어난 성능으로 무장한 라마 4는 클라우드 기반 독점 AI 플랫폼을 구축한 구글, 마이크로소프트, 아마존 등 빅테크 기업들과 에이전트 AI 시장에서 본격적인 경쟁에 돌입할 전망이다. 최근 멀티모달 AI 기반 이미지 업데이트로 주목 받은 오픈AI에도 위협이 될 수 있다는 관측이다.

특히 스카우트의 문맥 이해 능력이 경쟁 모델을 압도하며, 기업 및 공공기관의 에이전트 AI로 채택될 가능성이 높아지고 있다. 국내 AI 스타트업도 라마 4의 오픈소스 접근성을 활용해 모델을 채용 중이다. 한층 강화된 성능으로 AI 시장의 기술 진보도 기대된다.

한 AI 스타트업 관계자는 “라마는 이미 뛰어난 접근성으로 개발자들 사이에서 널리 사용되는 모델”이라며 “라마 4는 국내 기업이 중국과의 에이전트 AI 경쟁에서 유리한 위치를 점할 수 있는 무기가 될 것”이라고 말했다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)