엔비디아는 18일(현지시간) 미국 캘리포니아주 새너제이 SAP센터에서 반도체 컨퍼런스 GTC 2025를 개최하고 2028년까지 AI칩 출시 계획을 공개했다.

젠슨 황 엔비디아 최고경영자(CEO)는 "올해 블랙웰(GB200)의 업그레이드 버전인 '블랙웰 울트라(GB300)'를 출시해 빅테크의 AI칩 수요에 대응하고 2026년 신형 AI칩 '루빈'과 AI칩과 중앙처리장치(CPU)를 결합한 '베라 루빈'을 출시할 계획"이라며 "2028년에는 완전히 새로운 AI칩인 '파인먼'을 선보일 예정"이라고 말했다.

황 CEO에 따르면 블랙웰을 적용한 AI 데이터센터의 추론 성능은 이전 칩인 '호퍼(H100)'보다 68배, 루빈은 900배 우수하다. 현재 아마존, 마이크로소프트, 구글, 오라클 등 4대 클라우드 기업(하이퍼스케일러)은 지난해 호퍼를 130만개 구매했고 올해 블랙웰을 360만개 구매할 예정이다.

황 CEO는 288개의 블랙웰 울트라를 차세대 데이터 연결 기술인 '엔비링크72L'로 하나로 결합한 슈퍼컴퓨터 '블랙웰 울트라 DGX 슈퍼팟'을 공개하고 "11.5엑사플롭스(FP4 기준)의 성능을 내는 AI 공장의 역할을 하게 될 것"이라고 강조하기도 했다. 이는 현재 세계 1위 슈퍼컴퓨터인 미국 '엘 캐피탄'보다 5배 이상 우수한 성능이다.

내년 하반기에 공개하는 루빈에는 AI칩 중 최초로 6세대 고대역폭 메모리(HBM4)를 탑재한다. 현재 전 세계에서 HBM4를 상용화하는 데 성공한 기업은 SK하이닉스뿐이다. 마이크론은 올 상반기 공개를 목표로 HBM4 개발을 진행 중이다. HBM4는 초당 8TB의 속도로 데이터를 주고받았던 HBM3E보다 1.7배 빠른 초당 13TB의 속도로 데이터를 주고받아 AI 학습·추론 성능을 더 끌어올렸다.

2027년 출시하는 루빈 울트라에는 HBM4 12단보다 한층 용량이 늘어난 HBM4 16단을 적용한다. D램칩을 16개 쌓아 올려야 하는 초미세공정인 만큼 SK하이닉스는 적층 작업에 기존 적층 기술인 '첨단 매스리플로우몰디드언더필(MR-MUF)'과 함께 신 기술인 '하이브리드 본딩' 적용을 검토하고 있다. 2028년 출시하는 파인먼의 구체적인 사양은 미정이다.

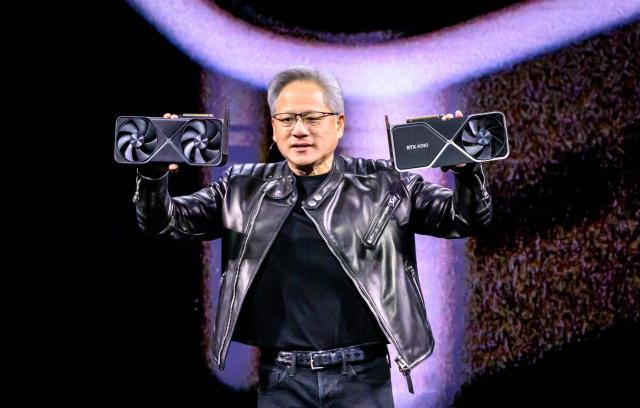

이날 황 CEO는 온 디바이스 AI 학습·추론에 최적화한 '블랙웰 RTX 프로'를 깜짝 공개하며 청중을 놀라게 하기도 했다. 블랙웰 RTX 프로는 32GB 용량의 7세대 그래픽용 메모리(GDDR7)를 탑재한 기존 블랙웰 RTX보다 메모리 용량을 3배(96GB) 확대해 단일 칩으로 소형언어모델과 온 디바이스 AI칩을 추론할 수 있는 게 특징이다. 이를 위해 AI칩 기판 한 면만 쓰던 기존 설계 대신 양면에 메모리를 붙이는 신기술을 적용했다. 현재 블랙웰용 GDDR7은 대부분 삼성전자가 공급하고 있는 것으로 알려졌다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)